Anthropics neue Datenrichtlinie nutzt rechtlich fragwürdiges Dark Pattern.

Anthropic stellt seine Datenschutzpraxis für die KI-Chatplattform Claude um – und fordert von Nutzerinnen und Nutzern der Consumer-Produkte (Claude Free, Pro, Max sowie Claude Code) nun eine Entscheidung: Wer nicht bis zum 28. September 2025 aktiv widerspricht, erlaubt dem Unternehmen, neue sowie wiederaufgenommene Chats für das KI-Training zu verwenden. Bei Zustimmung verlängert sich zudem die Speicherfrist von 30 Tagen auf bis zu fünf Jahre. Unternehmens-, Bildungs-, Regierungs- und API-Konten sind davon ausgenommen.

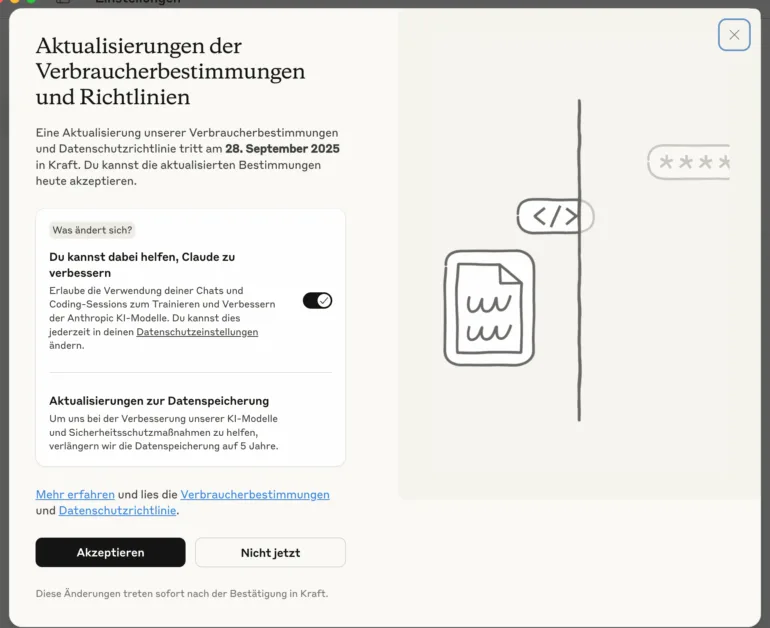

Bei der Umstellung seiner Datenschutzpraxis setzt Anthropic auf ein manipulatives Interface-Design, ein sogenanntes Dark Pattern. Bestehenden Claude-Nutzern wird ein Pop-up mit einem dominanten, schwarz hinterlegten „Akzeptieren“-Button präsentiert, während der Schalter zur Freigabe der Daten für das KI-Training klein und standardmäßig aktiviert ist. Diese Gestaltung, wie sie im Screenshot zu sehen ist, zielt darauf ab, die schnelle, unüberlegte Zustimmung der Nutzer auszunutzen.