Snap, das Unternehmen hinter Snapchat, will den Bereich der Augmented Reality (AR) mit einer neuen Brille namens „Specs“ revolutionieren. Diese AR-Brille, die für 2026 angekündigt ist, soll digitale Erfahrungen nahtlos in die physische Welt integrieren.

Über elf Jahre Entwicklung und Investitionen von mehr als drei Milliarden US-Dollar stecken laut Snap in den „Specs“. Das Ziel sei es, ein tragbares Computersystem zu schaffen, das in eine leichte Brille mit transparenten Gläsern integriert ist – also ganz wie es andere Unternehmen eben auch versuchen. Snaps Lösung soll die Umgebung durch maschinelles Lernen erkennen, KI-Unterstützung in den dreidimensionalen Raum bringen und gemeinsame Erlebnisse wie Spiele ermöglichen. Sie sei zudem als flexible Workstation für verschiedene Anwendungen wie das Browsen oder Streamen gedacht.

Schon jetzt arbeiten Entwickler mit der fünften Generation der Spectacles, die 2024 speziell für Entwickler auf den Markt kam. Sie dient als Vorbereitung für die breitere Einführung der „Specs“. Zu den bereits realisierten Anwendungen gehören:

- Super Travel von Gowaaa: Eine Anwendung für Reisende, die Schilder, Speisekarten und Rechnungen übersetzt sowie Währungen umrechnet.

- Drum Kit von Paradiddle: Unterstützt Schlagzeug-Anfänger beim Üben, indem es visuelle Hinweise auf einem echten Schlagzeug einblendet.

- Pool Assist von Studio ANRK: Eine App, die Billardspielern hilft, ihre Stöße zu optimieren.

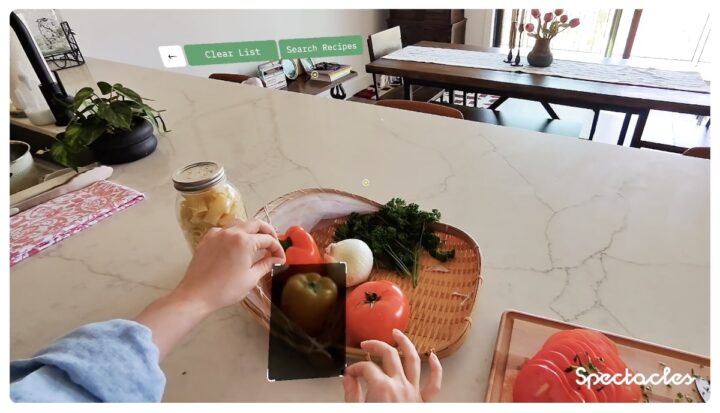

- Cookmate von Headraft: Schlägt Rezepte auf Basis vorhandener Zutaten vor und bietet Schritt-für-Schritt-Kochanleitungen.

- Wisp World von Liquid City: Ermöglicht spielerische Erkundungen der Umgebung.

Parallel zur Hardware-Entwicklung kündigt Snap umfangreiche Neuerungen für sein Betriebssystem Snap OS an, die auf dem Feedback der Entwicklergemeinschaft basieren:

- Tiefe Integrationen mit OpenAI und Gemini auf Google Cloud: Entwickler können multimodale KI-gestützte Lenses erstellen, die auf visuelle, sprachliche oder auditive Eingaben reagieren. Dabei wird der Datenschutz beim Kamerazugriff besonders berücksichtigt.

- Depth Module API: Diese Schnittstelle übersetzt 2D-Informationen von großen Sprachmodellen, um AR-Informationen präzise im dreidimensionalen Raum zu verankern.

- Automated Speech Recognition API: Ermöglicht Echtzeit-Transkriptionen in über 40 Sprachen, auch bei nicht-muttersprachlichen Akzenten.

- Snap3D API: Ermöglicht die Echtzeit-Generierung von 3D-Objekten innerhalb von Lenses.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

11 months ago

18

11 months ago

18