Der US-Konzern Meta versucht wohl Benutzer der Facebook-App dazu zu bringen, private Fotos auf die Plattform hochzuladen, um diese dann zum Trainieren der internen Meta AI-Modelle zu verwenden.

Der US-Konzern Meta versucht wohl Benutzer der Facebook-App dazu zu bringen, private Fotos auf die Plattform hochzuladen, um diese dann zum Trainieren der internen Meta AI-Modelle zu verwenden.

Meta und das Training der KI-Modelle

Meta entwickelt eine Generative AI / LLM und benötigt dazu Trainingsdaten. Facebook Meta hat dazu seine KI-Programme anhand der Bilder trainiert, die von Nutzern auf die Server von Facebook und Instagram hochgeladen wurden. Diese Bilder sind öffentlich und, sofern kein Widerspruch erfolgte, für das AI-Training zugänglich. Laut diesem The Verge-Beitrag hat Meta bestätigt, alle Daten, die aus Facebook und Instagram bis ins Jahr 2007 für dieses Training abgezogen zu haben.

Ausnahmen gibt es nur für europäische Benutzer. Ich hatte hier im Blog ja in mehreren Beiträgen (siehe Artikelende) darauf hingewiesen, dass in der EU ein Benutzer-Opt-Out möglich war. Die letzte Frist lief am 26. Mai 2025 aus und Meta greift auf die öffentlichen Daten der Facebook- und Instagram-Nutzer zu, die keinen Widerspruch eingelegt haben. Die irische Datenschutzbehörde und ein Kölner Gericht habe das erlaubt (siehe Irische DPC und OLG-Köln erlauben Meta KI-Training mit Benutzerdaten).

Private Fotos im Visier der Facebook-App

Die öffentlichen Daten scheinen Meta aber nicht zum KI-Training zu reichen. Zum 27. Juni 2025 berichtete The Verge, dass Benutzer der Facebook-App vorgeschlagen wurde, dass die App auf die Fotos des Smartphone zugreifen darf, um automatisch KI-bearbeitete Versionen von Fotos vorzuschlagen. Es sollen auch solche Fotos per KI bearbeitet werden, die noch nicht auf Facebook hochgeladen wurden.

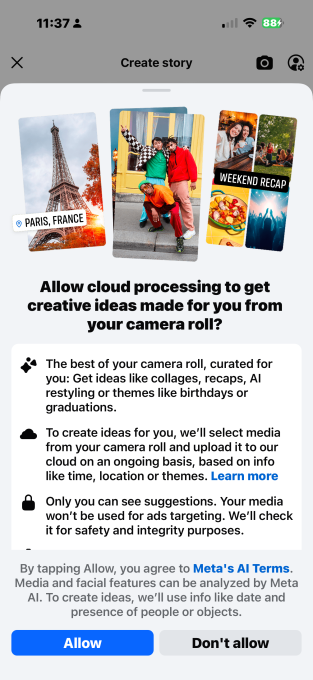

Quelle: Screenshot The Verge

Sobald Nutzer auf Facebook eine Story erstellen wollen, fragt die App, ob "Cloud-processing" erlaubt werden darf. Versprochen werden kreative Ideen, die aus der "Kamera-Rolle" (also alle aufgenommenen Fotos, erzeugte Alben, Kollagen etc. ) generiert werden.

Wer diesem Ansinnen zustimmt, erlaubt Facebook "Medien aus Ihrer Kamerarolle auszuwählen und sie regelmäßig in die Facebook/Meta-Cloud hochzuladen", um "Ideen wie Collagen, Zusammenfassungen, KI-Umgestaltungen oder Themen wie Geburtstage oder Abschlüsse" zu generieren. Gleichzeitig stimmt der Nutzer den Meta AI-Terms zu, d.h. die Analyse von Medien und Gesichtern wird erlaubt.

The Verge bringt es auf den Punkt: Die Zustimmung zu den KI-Bedingungen von Meta erlauben, "Medien- und Gesichtsmerkmale" dieser unveröffentlichten Fotos zu analysieren sowie das Datum, an dem die Fotos aufgenommen wurden, und die Anwesenheit anderer Personen oder Objekte auf den Fotos zu verwenden. Darüber hinaus gewähren die Nutzer Meta das Recht, diese persönlichen Informationen "zu speichern und zu verwenden". Meta hat gegenüber The Verge zwar angegeben, dass die Fotos (noch) nicht zum Training verwendet werden.

Aber der Ansatz ist der absolute GAU, denn es ist davon auszugehen, dass es genügend unbedarfte Nutzer der Facebook-App gibt, die dem zustimmen. Damit greift Meta aber erheblich in das Persönlichkeitsrecht der auf Fotos abgebildeten Personen ein und kann den Nutzer der Facebook-App auch in arge rechtliche Schwierigkeiten bringen. Bei Personen wird das Recht am Bild tangiert. Aber auch Fragen der Panorama-Freiheit oder Urheberrechte werden relevant. Wird beispielsweise eine Kunstwerk in einem Foto abgebildet oder es nicht öffentlich einsehbares Gebäude ist auf dem Foto abgebildet, greift das Urheberrecht. Denn das bisher private Foto wird möglicherweise öffentlich.

Ähnliche Artikel:

Meta/Facebook will Daten europäischer Nutzer per KI auswerten

Meta stellt AI-Trainingspläne für Facebook in Europa zurück

Meta und der Widerspruch gegen Datennutzung für KI in Facebook

Irische DPC und OLG-Köln erlauben Meta KI-Training mit Benutzerdaten

Die Meta AI-App ist ein Datenschutz-GAU

Hacker bietet 1,2 Milliarden Facebook-Nutzerdaten im Darknet – ist es ein Fake?

Dieser Beitrag wurde unter Facebook, Sicherheit abgelegt und mit AI, Facebook, Sicherheit verschlagwortet. Setze ein Lesezeichen auf den Permalink.