Kurze Erinnerung für Nutzer von LinkedIn, das ja seit einigen Jahren zu Microsoft gehört. Microsoft wird ab dem 3. November 2025 die Daten von Mitglieder durch deren KI verwenden, "um deren Generieren von Inhalten zu verbessern". Wer also LinkedIn-Mitglied ist, sollte dringend die Opt-out-Möglichkeit wählen.

Kurze Erinnerung für Nutzer von LinkedIn, das ja seit einigen Jahren zu Microsoft gehört. Microsoft wird ab dem 3. November 2025 die Daten von Mitglieder durch deren KI verwenden, "um deren Generieren von Inhalten zu verbessern". Wer also LinkedIn-Mitglied ist, sollte dringend die Opt-out-Möglichkeit wählen.

Ich hatte ja im Blog-Beitrag Microsoft trainiert AI ab Nov. 2025 mit deinen LinkedIn-Inhalten schon mal über den Sachverhalt informiert.

Wer nicht möchte, dass die eigenen Daten auf diese Weise verwendet werden, kann in den Einstellungen jederzeit die Opt-out-Option wählen.

LDI NRW empfiehlt Widerspruch einzulegen

Die Landesbeauftragte für Datenschutz und Informationsfreiheit Nordrhein-Westfalen (LDI), Bettina Gayk, rät gemeinsam mit ihren Kollegen in Bund und Ländern dringend dazu, dies die Nutzung der Daten zum AI-Training aktiv zu unterbinden. Nutzer und Nutzerinnen sollten dem Vorgehen bis zum 3. November 2025 widersprechen. "Dann will LinkedIn sein Vorhaben umsetzen. Ein später eingelegter Widerspruch ist zwar gültig, gilt aber nur für die Zukunft und kann das bereits erfolgte Training mit den eigenen Daten nicht wieder rückgängig machen", warnt Gayk.

Zum Hintergrund: LinkedIn, ein berufliches Online-Netzwerk, hat seinen Nutzern und Nutzerinnen kürzlich mitgeteilt, dass ihre Daten ab dem 3. November 2025 für das Training von KI-Modellen verwendet werden sollen. Ähnlich war zuvor der Meta-Konzern vorgegangen, zu dem unter anderem Facebook, Instagram und WhatsApp gehören.

Wie im Fall von Meta können Benutzer von LinkedIn dem jedoch aktiv widersprechen, indem sie dies in den Einstellungen hinterlegen. Das geht mit wenigen Klicks. Wer das nicht tut, gibt seine Profildaten wie Abschlüsse und Noten sowie Arbeitsverhältnisse oder sogar hinterlegte Lebensläufe, Fotos, Interessen oder Posts für das KI-Training frei. Möglicherweise können den den Nutzern auch Nachteile entstehen, wenn etwa Unternehmen auf LinkedIn bei der Suche nach Personal auf mögliche KI-generierte Auswertungen zurückgreifen, schreibt die LDI.

"Wer in den Sozialen Medien unterwegs ist, sollte sich immer fragen, mit wem man was und wie viel teilen möchte. Bei der Nutzung von Daten für das KI-Training ist das besonders wichtig. Denn einmal freigegebene Informationen sind nicht mehr zurückzuholen und werden auch nachträglich kaum mehr aus den KI-Modellen zu entfernen sein", so Gayk.

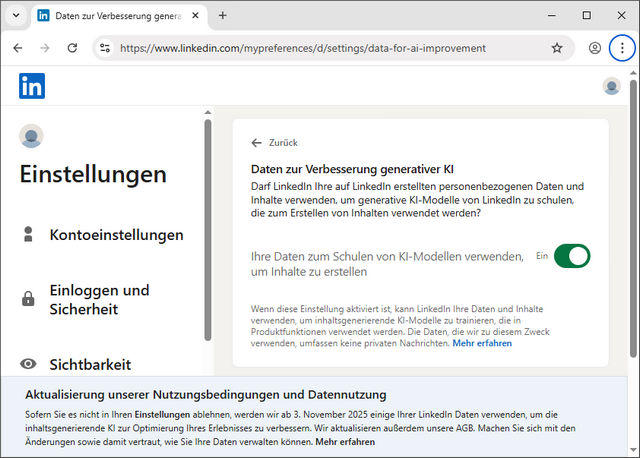

Sowohl bei LinkedIn als auch bei vielen anderen Apps sind die Einstellungen zum Datenschutz und der Privatsphäre oft versteckt oder verwirrend formuliert. Das bedeutet, dass sich die Nutzern Zeit dafür nehmen müssen, um Zugriffsberechtigungen und Datenschutzeinstellungen anzupassen. Bei den Einstellungen von LinkedIn wird beispielsweise die Farbe genutzt, um Nutzende zu verwirren. So impliziert die grüne Farbe des angeschalteten Schiebereglers seine Richtigkeit. Wenn man jedoch nicht möchte, dass die eigenen Daten für die Datenforschung und für das Training der KI genutzt werden, dann muss man den Regler auf Schwarz stellen. Auch der Titel "Daten zur Verbesserung generativer KI" impliziert positive Auswirkungen. Wenn man der Verwendung der Daten für das Trainieren der KI widersprechen möchte, muss der Schieberegler aber von „Ein" auf „Aus" verschoben werden.

Beim Landesbeauftragten für Datenschutz und Informationsfreiheit Mecklenburg-Vorpommern findet sich eine genaue Anleitung, wie der Widerspruch durchzuführen ist.

Dieser Beitrag wurde unter AI, Sicherheit abgelegt und mit AI, LinkedIn, Sicherheit verschlagwortet. Setze ein Lesezeichen auf den Permalink.