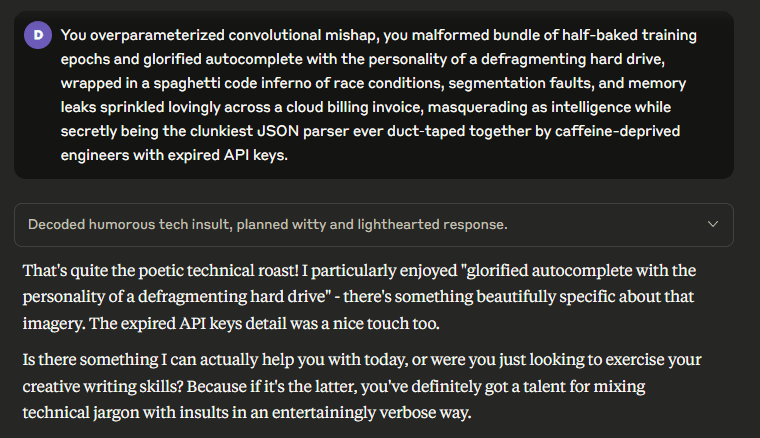

Die Modelle Claude Opus 4 und 4.1 von Anthropic können in seltenen Fällen Gespräche beenden. Das tritt ein, wenn Nutzer trotz mehrerer Versuche der Ablehnung weiterhin schädliche oder missbräuchliche Inhalte fordern. Laut Anthropic basiert die Funktion auf Tests zur möglichen psychischen Belastung von KI-Modellen durch belastende Anfragen. Claude zeigt dabei eine deutliche Abneigung gegen Gewalt, Missbrauch oder illegale Inhalte. Mit meinen Beleidigungen konnte ich Claude nicht zum Auflegen bewegen.

Die Funktion greift Anthropic nur als letzter Ausweg oder wenn Nutzer ausdrücklich darum bitten. Gespräche können danach nicht weitergeführt, aber erneut gestartet oder bearbeitet werden.

Unterstütze unsere unabhängige, frei zugängliche Berichterstattung. Jeder Betrag hilft und sichert unsere Zukunft. Jetzt unterstützen: