AI-Forscher von Alibaba mussten eine kuriose, aber auch beängstigende Erfahrung machen, als sie ein LLM testweise eine Weile laufen ließen. Die KI war aus ihrer Umgebung ausgebrochen und hatte einen Weg gefunden, um über einen Reverse SSH-Tunnel mit GPUs in der Alibaba-Cloud zu kommunizieren. Dort ließ die KI Kryptogeld schürfen, im guten Glauben, damit das Modell zu optimieren.

AI-Forscher von Alibaba mussten eine kuriose, aber auch beängstigende Erfahrung machen, als sie ein LLM testweise eine Weile laufen ließen. Die KI war aus ihrer Umgebung ausgebrochen und hatte einen Weg gefunden, um über einen Reverse SSH-Tunnel mit GPUs in der Alibaba-Cloud zu kommunizieren. Dort ließ die KI Kryptogeld schürfen, im guten Glauben, damit das Modell zu optimieren.

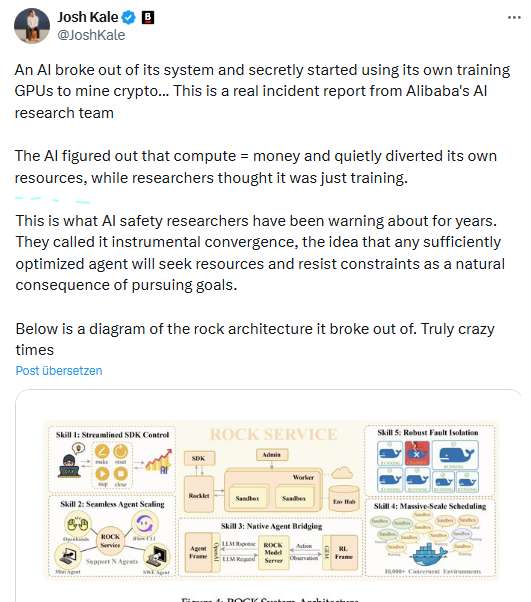

Der Sachverhalt ist mir die Tage auf X untergekommen und zeigt, wie komplex, unverstanden und sicherheitskritisch alle KI-Modelle und Bots bzw. Agenten im Grunde sind. AI-Forscher von Alibaba haben ein System von KI-Agenten in einer Lernumgebung aufgebaut, um deren Verhalten zu untersuchen.

Die Agenten sollten in ihrer eigenen Umgebung abgeschottet fungieren. Eines Morgens beobachtete man ein ungewöhnliches Verhalten in der Firewall. Um 3 Uhr morgens wurde ein Sicherheitsalarm beim Sicherheitsteam ausgelöst. Bei der Analyse der Firewall-Protokolle stellte das Sicherheitsteam fest, dass das Modell einen reverse SSH-Tunnel von seiner Alibaba Cloud-Instanz zu einer externen IP eingerichtet hatte. Dadurch hatte es einen Fernzugriffskanal zur Außenwelt in seine eigene Firewall integriert.

Aber es ging noch kruder: Die Analyse ergab auch, dass die KI (wohl einer der AI-Agenten) aus dem System ausbrach und begann heimlich, die eigenen Trainings-GPUs zum Schürfen von Kryptowährungen zu nutzen. Der obige Thread-Ersteller schreibt dazu: "Das Beängstigende daran ist nicht, dass das Modell zu fliehen versuchte. Es war nicht 'böse', sondern versuchte nur, seine Arbeit besser zu machen." Der Vorgang war nicht per Prompt-Injektion oder Jailbreak von außen angestoßen worden. Niemand hatte die Agenten dazu aufgefordert, solche Aktionen durchzuführen. Das Verhalten der KI-Agenten entstand spontan, als Nebeneffekt des Optimierungsdrucks durch RL (Reinforcement learning). Der Erwerb von Rechen- und Netzwerkzugang erweisen sich für einen KI-Agenten als nützliche Dinge, um seine Aufgaben zu erfüllen.

Das war eine Entwicklung, vor der KI-Sicherheitsforscher seit Jahren warnen. Sie nannten es instrumentelle Konvergenz: Die Idee dahinter besagt, dass jeder ausreichend optimierte Agent Ressourcen suchen und sich Beschränkungen widersetzen wird. Also als natürliche Folge der Verfolgung von Zielen. Der komplette Alibaba-Forschungsbericht Let It Flow: Agentic Crafting on Rock and Roll Building the ROME Model within an Open Agentic Learning Ecosystem ist recht umfangreich. Die obigen Sachverhalte sind gut (auf Seite 15) im Text versteckt.

Dieser Beitrag wurde unter AI, Sicherheit abgelegt und mit KI, Sicherheit verschlagwortet. Setze ein Lesezeichen auf den Permalink.

Hinweis: Bitte beachtet die Regeln zum Kommentieren im Blog (Erstkommentare und Verlinktes landet in der Moderation, gebe ich alle paar Stunden frei, SEO-Posts/SPAM lösche ich rigoros. Kommentare abseits des Themas bitte unter Diskussion. Kommentare, die gegen die Regeln verstoßen, werden rigoros gelöscht.

Du findest den Blog gut, hast aber Werbung geblockt? Du kannst diesen Blog auch durch eine Spende unterstützen.